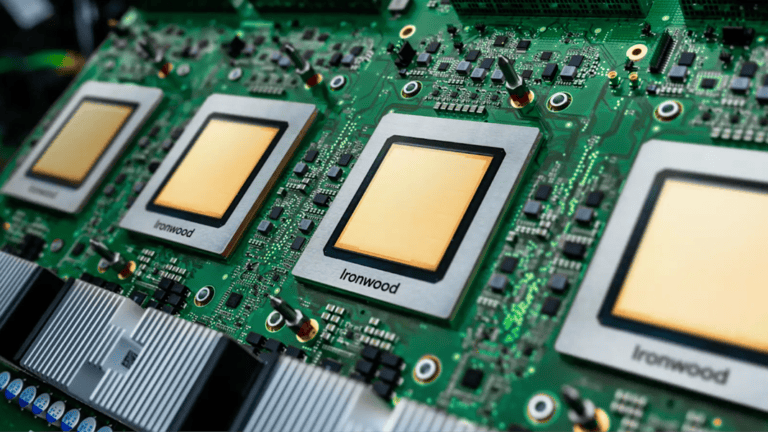

Google heeft tijdens Google Cloud Next in Las Vegas haar nieuwste Tensor Processing Unit (TPU) onthuld: Ironwood. Deze zevende generatie TPU is de krachtigste en meest schaalbare AI-chip die Google ooit heeft ontwikkeld en is speciaal ontworpen voor inferentie. Het markeert volgens Google het begin van een nieuw tijdperk waarin AI proactief inzichten genereert in plaats van enkel reactief informatie te verwerken.

Ironwood is gebouwd om het volgende stadium van generatieve AI te ondersteunen, waarin kunstmatige intelligentie niet alleen antwoorden geeft op basis van bestaande data, maar proactief informatie verzamelt en interpreteert. Google noemt dit het “tijdperk van inferentie”, waarin AI-agents zelfstandig data ophalen en genereren om inzichten te leveren.

Deze nieuwe AI-accelerator kan opschalen tot maar liefst 9216 chips die zijn verbonden via een revolutionair Inter-Chip Interconnect (ICI) met een vermogen van bijna 10 MW. Daarmee levert Ironwood een ongekende rekenkracht voor de meest veeleisende AI-workloads.

Enorme rekenkracht voor complexe AI-modellen

Ironwood is ontworpen om de complexe berekeningen van “redenerende modellen” zoals Large Language Models (LLM’s) en Mixture of Experts (MoE’s) uit te voeren. Voor Google Cloud-klanten komt de TPU in twee configuraties: een 256-chips variant en een 9.216-chips variant.

De grootste configuratie levert wel 42,5 Exaflops aan rekenkracht, wat volgens Google meer dan 24 keer krachtiger is dan ’s werelds grootste supercomputer, El Capitan, die ‘slechts’ 1,7 Exaflops per pod biedt. Elke afzonderlijke chip levert 4614 TFLOPs aan rekenkracht. Dit is een enorme vooruitgang ten opzichte van eerdere generaties TPU’s die Google samen met Broadcom heeft ontwikkeld.

Ironwood TPU is efficiënter en beschikt over meer geheugen

Google heeft niet alleen de rekenkracht verbeterd, maar ook gefocust op energie-efficiëntie. Ironwood is twee keer zo energie-efficiënt als Trillium, de zesde generatie TPU die vorig jaar werd aangekondigd. Dit is belangrijk in een tijd waarin beschikbare energie een van de beperkende factoren is voor AI-capaciteiten.

Daarnaast biedt Ironwood 192 GB High Bandwidth Memory (HBM) per chip, zes keer zoveel als Trillium. Ook de HBM-bandbreedte is aanzienlijk verbeterd en bereikt 7,4 Tbps per chip, 4,5 keer zoveel als zijn voorganger. De verbeterde Inter-Chip Interconnect (ICI)-bandbreedte is verhoogd tot 1,2 Tbps bidirectioneel, wat 1,5 keer sneller is dan bij Trillium.

Deze nieuwe AI-versneller bouwt voort op eerdere generaties TPU’s die Google Cloud heeft ingezet voor het versnellen van AI-ontwikkeling.

De toekomst van AI-chips

Volgens Google vertegenwoordigt Ironwood een unieke doorbraak in het tijdperk van inferentie met verhoogde rekenkracht, geheugencapaciteit, ICI-netwerkverbeteringen en betrouwbaarheid. Gecombineerd met een bijna twee keer zo grote verbetering in energie-efficiëntie, kunnen klanten nu trainings- en inferentie-workloads uitvoeren met de hoogste prestaties en de laagste latentie.

Toonaangevende AI-modellen zoals Gemini 2.5 en het met de Nobelprijs bekroonde AlphaFold draaien momenteel al op deze TPU’s. Google verwacht dat Ironwood, dat later dit jaar beschikbaar komt, nog veel meer AI-doorbraken mogelijk zal maken, zowel binnen Google zelf als bij Google Cloud-klanten.

Leer meer op de Google Cloud Summit Benelux

Op 14 en 15 mei organiseert Google de Google Cloud Summit Benelux 2025 in het Taets Art en Event Park in Zaandam. Toegang tot dit event is gratis.

Op 14 mei organiseert Google een dag voor zakelijke beslissers die meer willen weten wat Google Cloud kan betekenen voor hun organisatie. Meer specifiek is er een focus op AI, app ontwikkeling, data, samenwerken en security.

Op 15 mei richt Google zich op de ontwikkelaars, met hands-on sessies, een hackathon en diverse technische workshops.

Meer informatie en registratie voor het event kan via deze pagina.